Статті

Рекомендації щодо зменшення дезінформації на YouTube

Чому важливо досліджувати дезінформацію на YouTube?

YouTube сьогодні — одна з найпопулярніших соціальних мереж у Польщі та Україні: дві третини населення мають активний акаунт і використовують платформу для перегляду розважального та інформаційного відеоконтенту. “Серцем” YouTube є його алгоритм рекомендацій, адже якісна та індивідуалізована добірка схожих відео утримує глядачів на платформі, даючи їй змогу заробити ще більше на рекламі, а користувачам легко знаходити відео за інтересами.

Read in English

От тільки така бізнес-модель може заохочувати до створення ще більш емоційних та маніпулятивних відео, а самі алгоритми рекомендацій можуть легко затягнути в бульбашку конспірології та дезінформації, про що ще 2019 року випустила велике дослідження Mozilla Foundation. Тоді дослідники довели, що YouTube може не тільки рекомендувати відео, які порушують його ж політику, а й таким чином безпосередньо впливати на життя та ментальне здоровʼя своїх користувачів. І для неангломовного користувача ризики вищі.

Тому постає питання: яку роль може відігравати YouTube сьогодні в українсько-російській війні? Наскільки алгоритми рекомендацій платформи помічні для транслювання російських тез і пропаганди на українську аудиторію під час війни? Чи достатні алгоритми модерації та вжиті заходи з блокування основних пропагандистських каналів і спікерів на платформі? Чи все ж таки є прогалини, що дають змогу використовувати YouTube як механізм інформаційного впливу? І чи різняться ризики для України та Польщі (яка є частиною юридичного простору ЄС, одним із основних українських партнерів і прихистком для найбільшої кількості українських біженців, а отже, може стати мішенню російського інформаційного впливу). Відповіді на ці запитання ми намагалися знайти в межах нашого дослідження.

Отже, з огляду на масштабність інформаційних впливів у відеоформаті онлайн Texty.org.ua дослідили роботу алгоритму рекомендаційної системи YouTube в Україні та Польщі. У дослідженні взяли участь 205 українців і 122 поляки, які встановили спеціальний застосунок і погодилися передавати інформацію про всі свої перегляди на платформі.

Рекрутинг учасників в Україні здійснювала дослідницька агенція Info Sapiens, у Польщі — MASMI. До дослідження запрошувалися лише повнолітні респонденти, які переглядають відеоконтент на YouTube з персональних комп’ютерів або ноутбуків (браузер Google Chrome) щонайменше кілька разів на тиждень.

Отримані результати ми проаналізували за допомогою методів описової статистики, визначення тем (topic modeling) та розпізнавання іменованих сутностей (Named-entity recognition, NER), імплементованих у Python-бібліотеках pandas, yt-dlp та BERTopic.

Що з’ясувалося?

Ми виявили, що алгоритм рекомендацій YouTube має вади, які дають змогу зацікавленим сторонам поширювати пропаганду та дезінформацію. А політика платформи спрямована на вирішення поточних проблем і не передбачає системної роботи з вилучення чи обмеження пропаганди, яку здійснюють авторитарні режими, використовуючи YouTube. І справді, у процесі дослідження ми виявили, що YouTube через рекомендації просуває загрозливий і небезпечний як для окремого глядача, так і для національної безпеки України контент.

У контексті війни Росії проти України алгоритм рекомендацій YouTube не чутливий до питання російської агресії і не бачить проросійськості, тобто поглядів, які підтримують/виправдовують політику керівництва РФ. І глядач, наприклад, проросійського блогера отримує пропозиції переглянути інших схожих блогерів та канали, зокрема й ті, що заборонені в Україні.

На відміну від українського сегмента YouTube у польському ми зафіксували меншу кількість відео, які містять проросійські або антиукраїнські наративи, що в контексті війни часто одне й те саме. Та навіть у польському сегменті ми побачили, як рекомендації створюють пропагандистську воронку. Варто людині переглянути сумнівне відео, як система автоматично підкидає їй багато схожих.

Чому так відбувається?

1. YouTube намагається орієнтуватися на інтереси користувача. Платформа часто рекомендує користувачеві контент, бо його переглядають інші користувачі зі схожими інтересами.

Тобто якщо ви дивитеся кулінарні шоу, а кілька інших користувачів, які теж дивляться кулінарні шоу, переглянули відео з російською пропагандою, то система, найімовірніше, пропонуватиме пропаганду і вам.

2. Платформа класифікує кожне відео як таке, що належить до окремої категорії, на основі інформації, що міститься в ньому: заголовок, опис, ключові слова та власний аналіз відеоряду. Категорія відео впливає на просування системою рекомендацій. Але ми виявили, що алгоритми визначення категорії часом розмиті й платформа часто припускається неточностей, зокрема некоректно категоризує цілком однозначні відео. Наприклад, коли відео з відвертими пропагандистами категоризувалися як ігровий або розважальний контент. Таким чином російська державна система пропаганди підлаштовується під правила YouTube і намагається їх обійти та просочитися до якомога ширшої аудиторії.

Як наслідок — коли платформа YouTube неправильно категоризує пропагандистське відео й маркує його як “Ігри”, а конспірологію як “Навчальне”, це негативно впливає на користувачів, які прийшли переглянути ігровий або освітній контент. Такі випадки було виявлено в ході дослідження. А з огляду на пункт 1 такі відео після перегляду одним користувачем рекомендуються й іншим зі схожими інтересами.

3. Історія переглядів дуже впливає на систему рекомендацій. Навіть якщо людина дивиться нове відео із зовсім іншої сфери, YouTube просуває контент із каналів, які вона переглядала раніше. І якщо користувач змінює свої уподобання, то він отримуватиме ще деякий час у рекомендаціях відео “по старій пам’яті”. Це подекуди створює ефект інформаційної бульбашки, або циклічності.

Після повномасштабного російського вторгнення 24 лютого 2022 року багато українців змінило своє ставлення до Росії й декларувало відмову від перегляду російського контенту, але через таку особливість YouTube їх “наздоганяло минуле”, тобто платформа й далі рекомендувала відео з урахуванням довоєнних інтересів, таким чином створюючи поле впливу для російської пропаганди.

4. Персоналізація. Ефект бульбашки також затверджує механізм у рекомендаціях: якщо користувач переглядав відео з якоюсь персоною, платформа рекомендуватиме йому значно більше контенту саме з цією персоною, що зменшує шанси нових людей потрапити до списку. З одного боку, це прив’язка до інтересів користувача. Логічно, що коли йому подобається певна особа, то він нею цікавитиметься. А з другого — це яскравий приклад формування бульбашки.

Було також зафіксовано випадки, коли система рекомендацій платформи YouTube просуває осіб та організації, яких сама ж і намагалася заборонити або зменшити їхній інформаційний вплив.

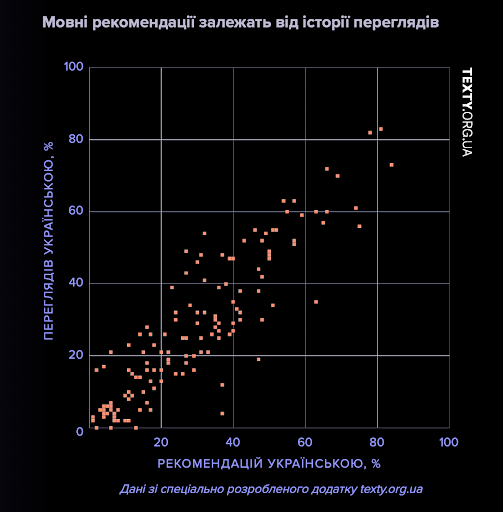

Окремо ми досліджували питання мови, оскільки українську громадськість хвилює засилля російської на YouTube. Але ми встановили пряму залежність мови рекомендованих відео від мови попередніх переглядів. Користувачам, які переглядають відео українською, платформа пропонує і наступні відео українською.

Численні соціологічні опитування (наприклад, Фонду «Демократичні ініціативи» ім. І.Кучеріва або соціологічної групи «Рейтинг») засвідчили, що після 24 лютого 2022 року значна частина українців вирішила спілкуватися виключно українською мовою. Але оскільки алгоритми YouTube також враховують попередню історію, то вони й надалі пропонують людині російськомовні відео, попри її внутрішні зміни. Оскільки користувач не може вплинути на алгоритми рекомендацій, вони таким чином ускладнюють реалізацію рішення відмовитися від колоніальної спадщини у вигляді російської мови й змінити мову спілкування. Адже для того, щоб легше змінити повсякденну мову, потрібно перебувати у відповідному мовному середовищі.

Також варто зазначити, що більша частина російських пропагандистських відео, які система рекомендацій YouTube пропонує українським користувачам, російськомовні (а не україномовні чи польськомовні). Наше дослідження в Польщі засвідчило, що незнання російської мови є суттєвим запобіжником у просуванні кремлівської пропаганди. Більшість поляків не знають російської мови, а отже, і не переглядають російськомовних відео із російською пропагандою чи просто конспірології, що є популярною в російськомовному сегменті YouTube.

Рекомендації YouTube

Потрібно спрямувати зусилля на блокування не окремих одиниць контенту чи окремих виробників, а цілих наративів, які просувають авторитарні режими. Для цього YouTube має змінити свою політику модерації від “латання дірок” до системного блокування контенту, який створюється на замовлення антидемократичних урядів і має на меті зруйнувати демократію, західний спосіб життя та виправдовувати війну проти незалежних країн.

Допоки вирішуватиметься це стратегічне завдання, кампанія з протидії пропаганді й дезінформації має зосередитися на кроках, які поліпшать інформаційне середовище YouTube.

1. Обмеження контенту, який фінансують тоталітарні режими

YouTube має ретельніше відфільтровувати відео з тоталітарних країн. Це особливо стосується пропагандистського контенту, який прославляє такі режими, вводить громадян в оману щодо реального стану справ, закликає до насилля та міждержавної ворожнечі. Причому пропагандистський контент можуть створювати формально незалежні від уряду люди та юридичні особи. Щодо української аудиторії, то ця рекомендація насамперед стосується контенту, виготовленого в Росії.

2. Санкції не лише проти каналів, а й проти людей

Механізми блокування YouTube передбачають блокування окремих каналів через порушення ними правил спільноти. Наприклад, поширення мови ненависті або відвертих фейків. Проте автори таких заблокованих каналів і далі зʼявляються як гості на інших каналах, фрагменти їхніх відео публікують мережі ботів або соціальних інженерів. Як наслідок — контент із такими пропагандистами і далі зʼявляється в рекомендаціях YouTube.

YouTube має передбачати алгоритми вилучення контенту з такими особами (їхніх наративів) зі своєї платформи, не обмежуючись лише їхнім авторським контентом, а видаляючи таких персон із соціальної мережі, якщо контент містить їхні наративи.

3. Категоризація

Якісніше категоризувати контент, більше орієнтуватися не на опис відео від авторів, а на його зміст. Це має виключити такі випадки, коли в категорії “Ігри” чи “Кіно” присутні російські пропагандисти. Такі приклади ми зафіксували і в українському, і в польському сегментах YouTube.

4. Українська мова

Для українського сегмента YouTube на цьому етапі варто розглядати українську мову як один із чинників для рекомендацій. Адже в україномовному сегменті набагато рідше з’являються російська пропаганда та дезінформація. Також це стане відповіддю на очікування українського суспільства щодо подолання колоніальної спадщини та відновлення використання української мови. Бажання більше послуговуватися українською і переглядати україномовний контент зафіксувало багато соціологічних опитувань. Таке нововведення від YouTube допоможе розірвати “пастку минулого”, коли, попри зміну поглядів та уподобань користувача, йому пропонуються відео на основі колишніх уподобань.

5. Урахування переліку осіб, на яких Україна, ЄС та США наклали санкції

YouTube має блокувати відеоконтент, який поширюється від імені підсанкційних осіб, на виправдання злочинів, скоєних особами, на яких накладено міжнародні санкції, або яких оголошено в міжнародний розшук, або на арешт яких накладено санкції Міжнародного кримінального суду. Обмежувати не тільки авторський контент таких осіб, а й всілякі способи їх виправдовування.

6. Зменшення кількості маніпулятивних (кричущих) заголовків

Пропагандисти й автори фейків та маніпуляцій часто використовують для своїх публікацій маніпулятивні “сенсаційні” й часто неправдиві заголовки, покликані залучити якомога більшу аудиторію. Алгоритми YouTube мають модерувати такі заголовки й у разі використання відвертої брехні або мови ворожнечі забороняти їх або цілий блок контенту під таким заголовком. А також сприяти підвищенню пріоритету для верифікованих медіа, які дотримуються журналістських стандартів.

7. Вдосконалення алгоритмів модерації псевдомедичного контенту російською та українською мовами

Особливо небезпечними можуть бути поширення неправдивого контенту на медичну тематику, прихована реклама псевдолікарських засобів або використання звичайних побутових засобів для лікування серйозних захворювань. Такі відео мають якісно модеруватися й прибиратися з платформи. А будь-який контент, який містить медичний зміст, має відповідним чином маркуватися з попередженням, що потрібно передусім використовувати методи доказової медицини та звертатися до лікаря й що самолікування шкідливе. І хоча YouTube вже доволі давно працює над модерацією такого контенту, проте в нашому дослідженні ми побачили, що алгоритми платформи для виявлення псевдомедичних і потенційно шкідливих відео російською та українською мовами недостатні. Приклади заголовків, які траплялися нашим користувачам серед рекомендованих до перегляду відео: “СОДА — лекарство от старости, РАКА и хронических воспалений! Как, сколько и какую соду нужно пить?”, “Спирулина — суперпища: от рака до насморка”.

Українській державі

Верховній Раді

Дослідження польського сегмента YouTube засвідчило, що вагомим чинником більш відповідальної політики щодо модерації контенту з боку онлайн-платформ є законодавче врегулювання цієї сфери. Ухвалений у ЄС Акт про цифрові послуги (Digital Services Act) став наступним кроком для забезпечення регулювання контенту та прозорості на найбільших онлайн-платформах включно з YouTube.

Оскільки вступ до ЄС може розтягнутися на невизначений термін, Україні варто запозичити норми та підходи цього та суміжних законів, які матимуть на меті:

- створити потужніші механізми громадського контролю за онлайн-платформами в Україні;

- зобов’язати великі платформи та пошукові системи суворо стежити за контентом, що розміщується, негайно вилучати незаконний і прибрати таргетовану рекламу на основі сексуальної орієнтації, релігії, етнічної належності чи політичних переконань;

- спростити механізм скарг від користувачів, ефективніше на нього реагувати й зробити процес модерації прозорішим з обовʼязковим повідомленням автора про причини блокування;

- вимагати, щоб онлайн-платформи забезпечували більшу прозорість роботи своїх алгоритмів та інформували про те, чому нам рекомендують той чи інший контент, із можливістю цілковито відмовитися від персоналізованого контенту.

Кабінету Міністрів

Оскільки українська мова є запобіжником поширенню російської пропаганди, через Український культурний фонд налагодити систему видачі грантів на створення україномовного контенту.

Також важливо передбачити штат працівників Центру стратегічних комунікацій та інформаційної безпеки при Мінкульті для відстежування дезінформаційного контенту та комунікації з великими технологічними платформами щодо способів удосконалення використовуваних ними алгоритмів модерації та рекомендацій.

Спільноті, яка протистоїть російській дезінформації

За прикладом польської організації “Ніколи знову” вести реєстр пропагандистів та каналів у YouTube, які поширюють російські меседжі, та вимагати від YouTube їх блокування.

Громадянам України

- Приклад Польщі засвідчив: для того щоб максимально уникати відео з російською пропагандою, потрібно взагалі перестати дивитися російськомовний контент.

- У жодному разі не переглядати контент російських пропагандистів навіть заради цікавості. Адже якщо ви подивилися таке пропагандистське відео, то YouTube його рекомендуватиме й іншим людям зі схожими інтересами. Також система пропонуватиме вам інших пропагандистів або відео із сірої зони.

- Скаржитися YouTube на всі пропагандистські відео, які вам трапляються.